共计 12868 个字符,预计需要花费 33 分钟才能阅读完成。

这几天对服务器兴趣贼为浓厚,在虚拟机上装了一个 CentOS7 玩了玩,遇到过很多问题,比如网卡驱动设置,不能 ping 等等问题,然后掏钱买个 ECS 搭服务器玩玩,下面就开始谢谢我的心路历程吧。

首先

买服务器,什么阿里云,百度云、腾讯云等等,随便买一个低配就好了,我买的学生机,9.9 一个月,便宜的不能再便宜了,廉价的不能再廉价了。

(自带 mysql 数据库,php Apache 运行环境,FTP,VSftpd,这让我省了很多事)

第一步:安装 jdk

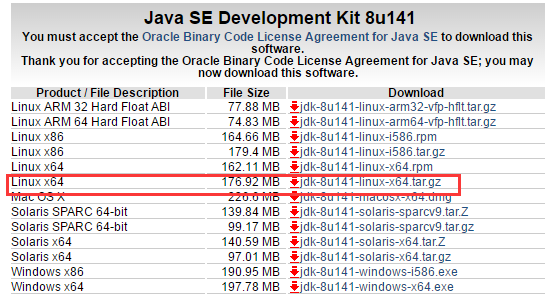

去官网下载 jdk(官网:http://www.Oracle.com/technetwork/java/javase/downloads/jdk8-downloads-2133151.html)

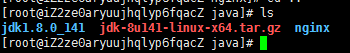

rz,上传 JDK,(比如我的目录是 /usr/java)

然后解压 jdk:tar -zxvf jdk-8u141-linux-x64.tar.gz

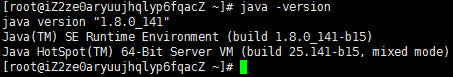

接下来配置环境变量,环境变量路径:/etc/profile(可以先 copy 一份,cp /etc/profile /etc/profile1)

vi /etc/profile 找到 export,添加如下内容

export JAVA_HOME=/usr/java/jdk/jdk1.8.0_112

export JRE_HOME=/usr/java/jdk/jdk1.8.0_112/jre

export CLASSPATH=.:$JAVA_HOME/lib:$JRE_HOME/lib:$CLASSPATH

export PATH=$JAVA_HOME/bin:$JRE_HOME/bin:$JAVA_HOME:$PATH(ps:根据各字的 jdk 版本稍加修改,后面不做阐述了哈)

ZZ 保存,然后输入命令:source /etc/profile。

OK,JDK 配置完成。

第二步:安装 tomcat

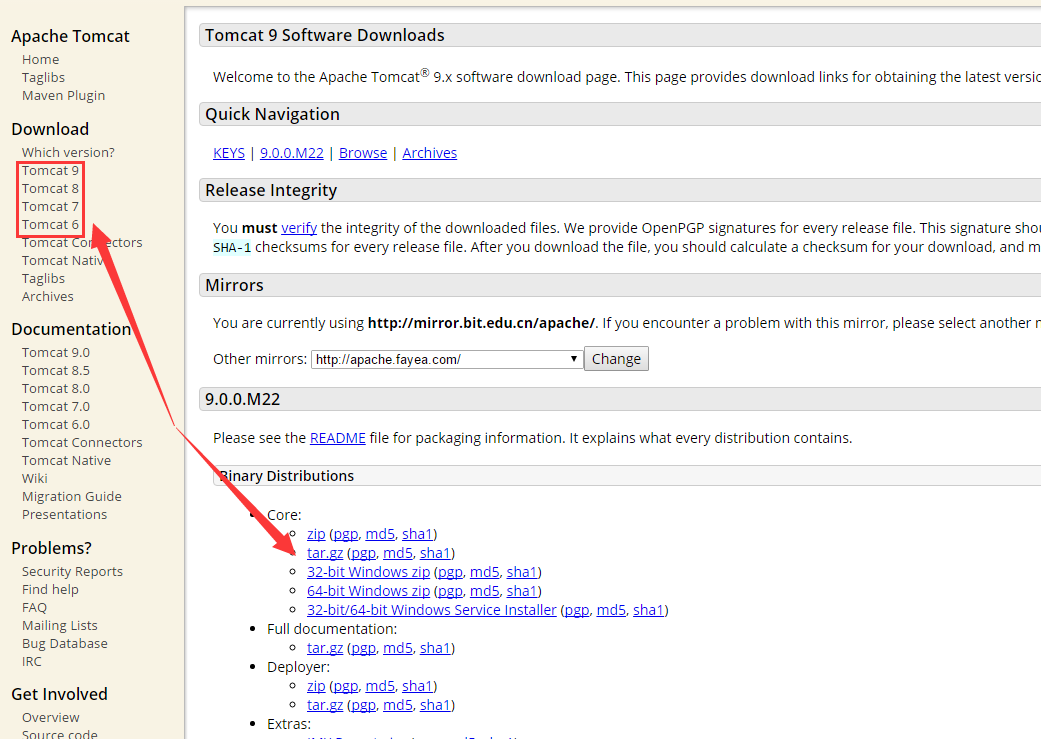

学过 java 的不用说,服务器不可少,还是老样子,上官网下载压缩包(官网:http://tomcat.apache.org/download-90.cgi)

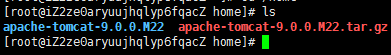

rz,上传压缩包(比如我的上传路径是:/home)

然后解压:tar -zxvf apache-tomcat-9.0.0.M22.tar.gz

启动 tomcat 方法一:进入该目录,./startup.sh。方法二:路径./startup.sh,比如:/home/apache-tomcat-9.0.0.M22/bin/./startup.sh

关闭 tomcat 方法一:进入该目录,./shutdown.sh。方法二:路径./shutdown.sh,比如:/home/apache-tomcat-9.0.0.M22/bin/./shutdown.sh

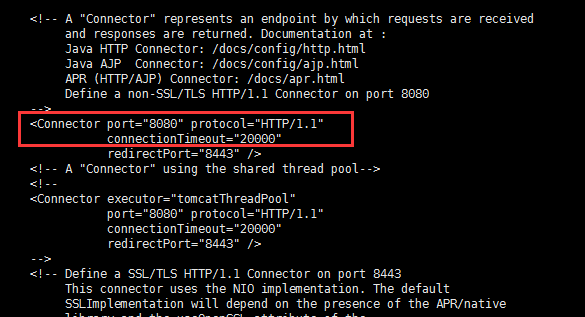

修改端口号在 ……../tomcat/conf/server.xml

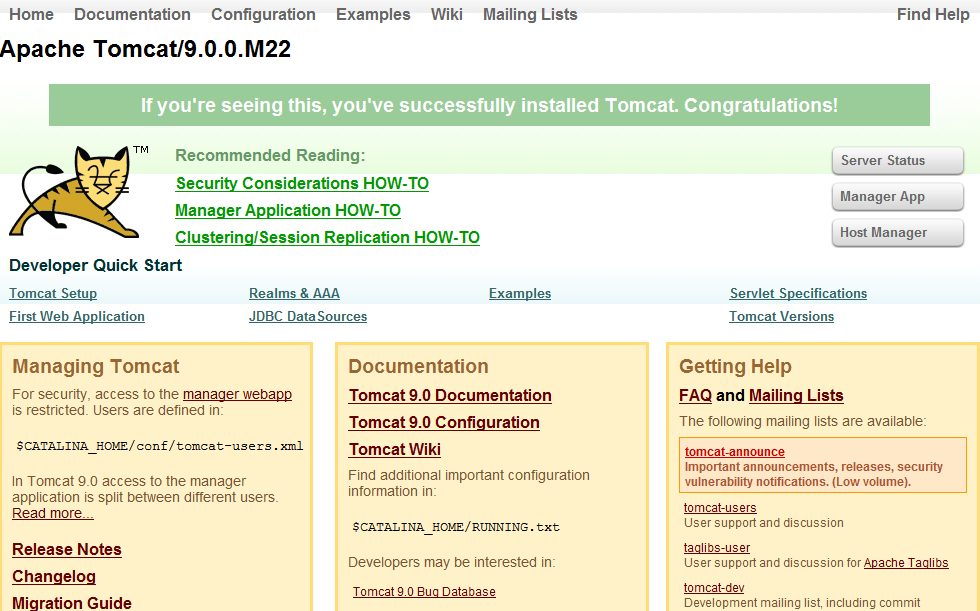

现在我们可以启动 tomcat 来看看是否配置成功了,启动 tomcat,在浏览器输入 http://ip: 端口号(http://59.110.158.250:8080)

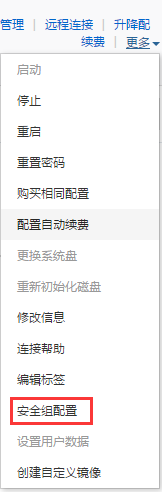

当然,不会有那么想象中那么顺利,因为这还有一个重要的安全组,我们打开控制台,点配置规则

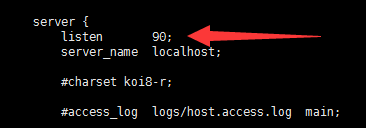

3389、22、-1,都是系统给配置好的,3306,虽然自带数据库,但是外部并不能访问,要把 3306 端口在安全组放开才能访问,如果放开了还不能访问,那就是要 mysql 的权限问题了,可以上网搜搜相关教程,http 的 80 端口毋庸置疑是必须打开的,https 的 443 端口我也打开了,还有 nginx 的 90 端口,为什么是 90 端口?因为我在前面说了,自带 php apache 的运行环境,端口号为 80,如果 nginx 也是 80 的话会造成端口号冲突。8080 就是大家都熟悉的 8080 端口了。(详细安全组参考:https://help.aliyun.com/document_detail/25475.html)端口号开放了,那么我们的 tomcat 服务器就搞定了,只要把相应的项目打成 war 包部署到 webapps 目录下即可。

OK,我们的服务器也配完了,接下来配 nginx 吧。

第三步:安装并配置 nginx

进入:/usr/java/nginx 位置

下载 nginx: wget http://nginx.org/download/nginx-1.8.0.tar.gz

下载 openssl : wget http://www.openssl.org/source/openssl-fips-2.0.9.tar.gz

下载 zlib : wget http://zlib.net/zlib-1.2.8.tar.gz

下载 pcre : wget ftp://ftp.csx.cam.ac.uk/pub/software/programming/pcre/pcre-8.38.tar.gz

(如果上面的包找不到,那就在自己电脑上下载然后上传到服务器即可,比如我的 nginx 是我自己下的版本 nginx1.12.1,官网:http://nginx.org/en/download.html)

(nginx1.12.1:http://nginx.org/download/nginx-1.12.1.tar.gz)

如果没有安装 c ++ 编译环境,还得安装,通过 yum install gcc-c++ 完成安装

下一步,编译安装

____________________________________________________________________________________

openssl:

[root@localhost] tar zxvf openssl-fips-2.0.9.tar.gz

[root@localhost] cd openssl-fips-2.0.9

[root@localhost] ./config && make && make install

_____________________________________________________________________________________

pcre:

[root@localhost] tar zxvf pcre-8.36.tar.gz

[root@localhost] cd pcre-8.36

[root@localhost] ./configure && make && make install

zlib:

[root@localhost]tar zxvf zlib-1.2.8.tar.gz

[root@localhost] cd zlib-1.2.8

[root@localhost] ./configure && make && make install

最后安装 nginx

[root@localhost]tar zxvf nginx-1.8.0.tar.gz

[root@localhost] cd nginx-1.8.0

[root@localhost] ./configure && make && make install

_______________________________________________________________________________________

启动 nginx

/usr/local/nginx/sbin/nginx

如果启动不成功因为端口号冲突,修改已经存在的 80 端口或者修改 nginx 的 80 端口,(注意:修改 nginx 端口不是在 /usr/java/nginx 位置,而是在 /usr/local/nginx/conf/nginx.conf)

启动成功之后,我们可以在浏览器访问,看看是否成功配置 nginx

我们的 nginx 配置成功,关于 nginx 负载均衡参考 http://www.linuxidc.com/Linux/2016-01/127255.htm,这里我详细说一下 nginx 配置文件

######Nginx 配置文件 nginx.conf 中文详解 #####

# 定义 Nginx 运行的用户和用户组

user www www;

#nginx 进程数,建议设置为等于 CPU 总核心数。

worker_processes

8

;

# 全局错误日志定义类型,[debug

| info | notice | warn | error |

crit ]

error_log/usr/local/nginx/logs/

error.log info;

# 进程 pid 文件

pid

/usr/local/nginx/logs/

nginx.pid;

# 指定进程可以打开的最大描述符:数目

# 工作模式与连接数上限

# 这个指令是指当一个 nginx 进程打开的最多文件描述符数目,理论值应该是最多打开文件数(ulimit

-n)与 nginx 进程数相除,但是 nginx 分配请求并不是那么均匀,所以最好与 ulimit –

n 的值保持一致。

# 现在在 linux2

.6 内核下开启文件打开数为 65535,worker_rlimit_nofile 就相应应该填写 65535。

# 这是因为 nginx 调度时分配请求到进程并不是那么的均衡,所以假如填写 10240,总并发量达到 3 –

4 万时就有进程可能超过 10240 了,这时会返回 502 错误。

worker_rlimit_nofile65535

;

events

{

| rtsig | epoll | /dev/poll | select |

poll ]; epoll 模型

2.6 以上版本内核中的高性能网络 I /

O 模型,linux 建议 epoll,如果跑在 FreeBSD 上面,就用 kqueue 模型。

4.1+, OpenBSD 2.9+, NetBSD 2.0

和 MacOS X. 使用双处理器的 MacOS X 系统使用 kqueue 可能会造成内核崩溃。

/dev/poll:使用于 Solaris 7 11/99+,HP/UX 11.22+ (eventport),IRIX 6.5.15+ 和 Tru64 UNIX 5.1A+

。

10

。为了防止出现内核崩溃的问题,有必要安装安全补丁。

= 连接数 *

进程数)

%

就行。每个进程允许的最多连接数,理论上每台 nginx 服务器的最大连接数为。

65535

;

60

;

~

]# getconf PAGESIZE

4096

=65535 inactive=

60s;

60

使用字段:http, server, location 这个指令指定了何时需要检查 open_file_cache 中缓存项目的有效信息.

1

使用字段:http, server, location

1

;

|

off 默认值:open_file_cache_errors off 使用字段:http, server, location 这个指令指定是否在搜索一个文件是记录 cache 错误.

}

# 设定 http 服务器,利用它的反向代理功能提供负载均衡支持

http

{

/octet-

stream;

-8

;

128

;

4

64k;

/

O 处理速度,降低系统的负载。注意:如果图片显示不正常把这个改成 off。

120

;

300

;

300

;

300

;

4

64k;

4

16k;

1.0;

#压缩版本(默认 1.1,前端如果是 squid2.5 请使用 1.0

)

2

;

/plain application/x-javascript text/css application/

xml;

192.168.80.121:80 weight=3

;

192.168.80.122:80 weight=2

;

192.168.80.123:80 weight=3

;

1

、轮询(默认)

2

、weight

192.168.0.14 weight=10

;

192.168.0.15 weight=10

;

2

、ip_hash

192.168.0.14:88

;

192.168.0.15:80

;

3

、fair(第三方)

4

、url_hash(第三方)

3128

;

3128

;

127.0.0.1:9090

down;

127.0.0.1:8080 weight=2

;

127.0.0.1:6060

;

127.0.0.1:7070

backup;

1

.down 表示单前的 server 暂时不参与负载

2

.weight 为 weight 越大,负载的权重就越大。

3

.max_fails:允许请求失败的次数默认为 1. 当超过最大次数时,返回 proxy_next_upstream 模块定义的错误

4

.fail_timeout:max_fails 次失败后,暂停的时间。

5

.backup:其它所有的非 backup 机器 down 或者忙的时候,请求 backup 机器。所以这台机器压力会最轻。

80

;

/data/www/

jd;

******

进行负载均衡

~ .*.(php|php5)?

$

127.0.0.1:9000

;

~ .*.(gif|jpg|jpeg|png|bmp|

swf)$

~ .*.(js|css)?

$

‘$remote_addr – $remote_user [$time_local] “$request” ‘

‘$status $body_bytes_sent “$http_referer” ‘

‘”$http_user_agent” $http_x_forwarded_for’

;

/usr/local/nginx/logs/

host.access.log

/usr/local/nginx/logs/host.access.404

.log

“/”

启用反向代理

/

{

-Real-

IP $remote_addr;

-Forwarded-

For 获取用户真实 IP

-Forwarded-

For $proxy_add_x_forwarded_for;

0

,提交一个比较大,200k 左右的图片,都返回 500 Internal Server Error 错误

90

;

90

;

90

;

4

32k;

*2

)

/

NginxStatus {

“NginxStatus”

;

~ .(jsp|jspx|

do)?

$ {

-Real-

IP $remote_addr;

-Forwarded-

For $proxy_add_x_forwarded_for;

~ .*.(htm|html|gif|jpg|jpeg|png|bmp|swf|ioc|rar|zip|txt|flv|mid|doc|ppt|

|xls|mp3|

wma)$

~ .*.(js|css)?

$

}

######Nginx 配置文件 nginx.conf 中文详解 #####

赶快去搭建属于你自己的服务器吧

本文永久更新链接地址:http://www.linuxidc.com/Linux/2017-07/145878.htm