共计 3874 个字符,预计需要花费 10 分钟才能阅读完成。

一、安装 Eclipse

下载 Eclipse,解压安装,例如安装到 /usr/local,即 /usr/local/eclipse

4.3.1 版本下载地址:http://pan.baidu.com/s/1gd29RPp

二、在 eclipse 上安装 Hadoop 插件

1、下载 hadoop 插件

下载地址:http://pan.baidu.com/s/1gd29RPp

此 zip 文件包含了源码,我们使用使用编译好的 jar 即可,解压后,release 文件夹中的 hadoop.eclipse-kepler-plugin-2.2.0.jar 就是编译好的插件。

2、把插件放到 eclipse/plugins 目录下

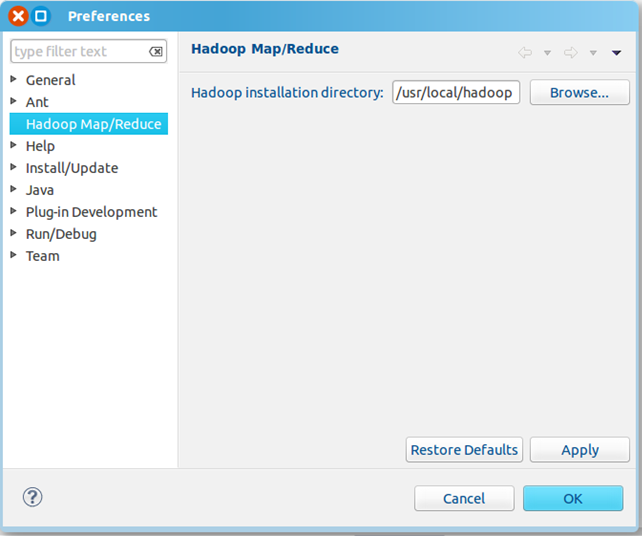

3、重启 eclipse,配置 Hadoop installation directory

如果插件安装成功,打开 Windows—Preferences 后,在窗口左侧会有 Hadoop Map/Reduce 选项,点击此选项,在窗口右侧设置 Hadoop 安装路径。

4、配置 Map/Reduce Locations

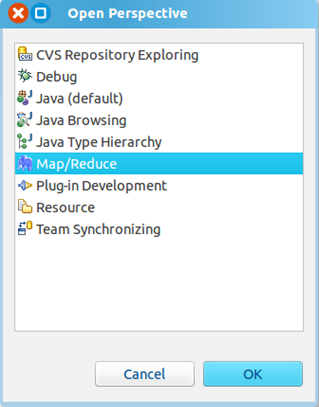

打开 Windows—Open Perspective—Other

选择 Map/Reduce,点击 OK

在右下方看到如下图所示

![]()

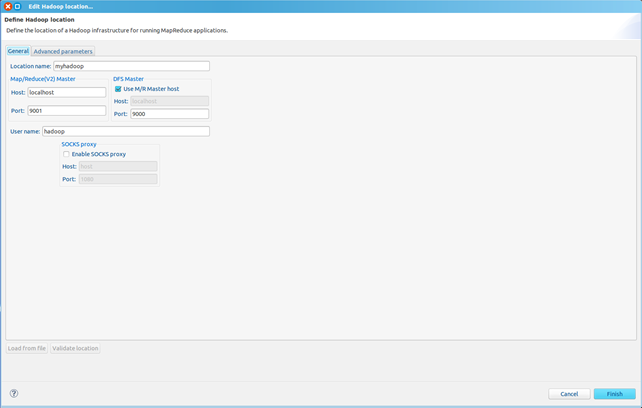

点击 Map/Reduce Location 选项卡,点击右边小象图标,打开 Hadoop Location 配置窗口:

输入 Location Name,任意名称即可. 配置 Map/Reduce Master 和 DFS Mastrer,Host 和 Port 配置成与 core-site.xml 的设置一致即可。

![]()

点击 ”Finish” 按钮,关闭窗口。

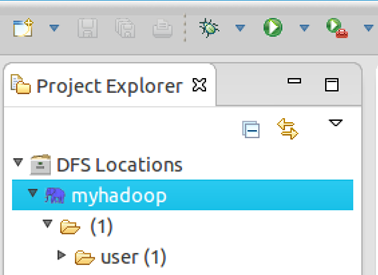

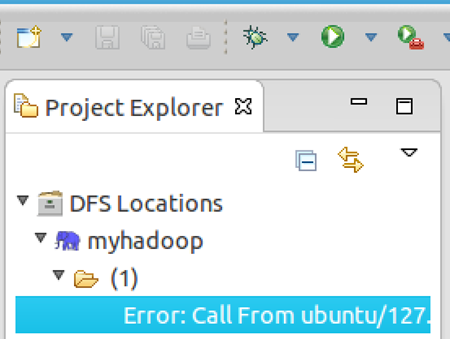

点击左侧的 DFSLocations—>myhadoop(上一步配置的 location name),如能看到 user,表示安装成功

如果如下图所示表示安装失败,请检查 Hadoop 是否启动,以及 eclipse 配置是否正确。

三、新建 WordCount 项目

File—>Project,选择 Map/Reduce Project,输入项目名称 WordCount 等。

在 WordCount 项目里新建 class,名称为 WordCount,代码如下:

import java.io.IOException;

import java.util.StringTokenizer;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.mapreduce.Reducer;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import org.apache.hadoop.util.GenericOptionsParser;

public class WordCount {

public static class TokenizerMapper extends Mapper<Object, Text, Text, IntWritable>{

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(Object key, Text value, Context context) throws IOException, InterruptedException {

StringTokenizer itr = new StringTokenizer(value.toString());

while (itr.hasMoreTokens()) {

word.set(itr.nextToken());

context.write(word, one);

}

}

}

public static class IntSumReducer extends Reducer<Text,IntWritable,Text,IntWritable> {

private IntWritable result = new IntWritable();

public void reduce(Text key, Iterable<IntWritable> values,Context context) throws IOException, InterruptedException {

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

result.set(sum);

context.write(key, result);

}

}

public static void main(String[] args) throws Exception {

Configuration conf = new Configuration();

String[] otherArgs = new GenericOptionsParser(conf, args).getRemainingArgs();

if (otherArgs.length != 2) {

System.err.println(“Usage: wordcount <in> <out>”);

System.exit(2);

}

Job job = new Job(conf, “word count”);

job.setJarByClass(WordCount.class);

job.setMapperClass(TokenizerMapper.class);

job.setCombinerClass(IntSumReducer.class);

job.setReducerClass(IntSumReducer.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

FileInputFormat.addInputPath(job, new Path(otherArgs[0]));

FileOutputFormat.setOutputPath(job, new Path(otherArgs[1]));

System.exit(job.waitForCompletion(true) ? 0 : 1);

}

}

四、运行

1、在 HDFS 上创建目录 input

hadoop fs -mkdir input

2、拷贝本地 README.txt 到 HDFS 的 input 里

hadoop fs -copyFromLocal /usr/local/hadoop/README.txt input

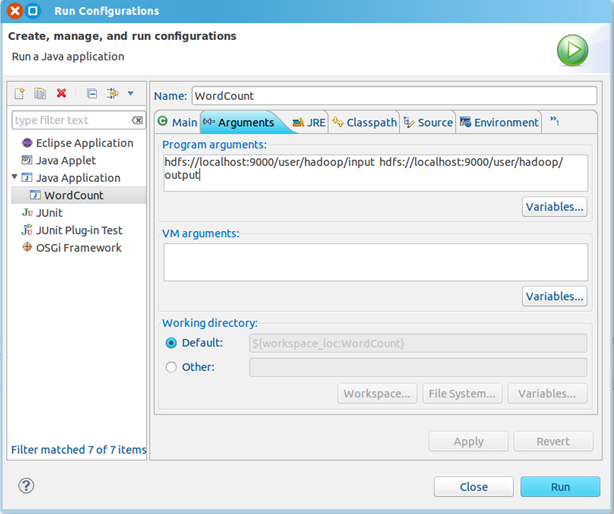

3、点击 WordCount.java,右键,点击 Run As—>Run Configurations,配置运行参数,即输入和输出文件夹

hdfs://localhost:9000/user/hadoop/input hdfs://localhost:9000/user/hadoop/output

点击 Run 按钮,运行程序。

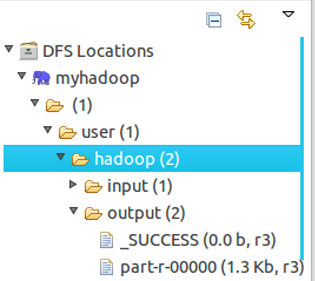

4、运行完成后,查看运行结果

方法 1:

hadoop fs -ls output

可以看到有两个输出结果,_SUCCESS 和 part-r-00000

执行 hadoop fs -cat output/*

方法 2:

展开 DFS Locations,如下图所示,双击打开 part-r00000 查看结果

CentOS 安装和配置 Hadoop2.2.0 http://www.linuxidc.com/Linux/2014-01/94685.htm

Ubuntu 13.04 上搭建 Hadoop 环境 http://www.linuxidc.com/Linux/2013-06/86106.htm

Ubuntu 12.10 +Hadoop 1.2.1 版本集群配置 http://www.linuxidc.com/Linux/2013-09/90600.htm

Ubuntu 上搭建 Hadoop 环境(单机模式 + 伪分布模式)http://www.linuxidc.com/Linux/2013-01/77681.htm

Ubuntu 下 Hadoop 环境的配置 http://www.linuxidc.com/Linux/2012-11/74539.htm

单机版搭建 Hadoop 环境图文教程详解 http://www.linuxidc.com/Linux/2012-02/53927.htm

搭建 Hadoop 环境(在 Winodws 环境下用虚拟机虚拟两个 Ubuntu 系统进行搭建)http://www.linuxidc.com/Linux/2011-12/48894.htm

更多 Hadoop 相关信息见 Hadoop 专题页面 http://www.linuxidc.com/topicnews.aspx?tid=13